こんにちは。ZOZO Researchの研究員の古澤・川島・平川、ZOZOのデータサイエンティストの荒木・小林です。2024年8月6日(火)から8月9日(金)にかけて熊本で開催された画像の認識・理解シンポジウムMIRU2024に参加しました。この記事では、MIRU2024でのZOZO Research・ZOZOのメンバーの取り組みやMIRU2024の様子について報告します。

目次

MIRU2024

MIRUとは、Meeting on Image Recognition and Understandingという画像の認識・理解についてのシンポジウムです。2024年の今回は熊本城ホールにおいて原則オフラインの形で開催されました。今年は過去最多の1591名もの方々が参加されたとのことで、会場が大きな賑わいを見せていました。ZOZO NEXTは、このMIRU2024にゴールドスポンサーとして協賛させていただきました。

また、今年は5年ぶりにバンケットも開催されました。バンケットは立食形式で行われ、おいしい食事やお酒、熊本ラーメンを堪能しながら他の参加者たちと交流しました。このように、同じ分野で研究している他の研究者たちと現地で交流したり、研究内容についてカジュアルに話し合ったりできるのもシンポジウムの良さのひとつです。私たちも、初めてお話しする方はもちろんのこと、過去に研究を通して知り合った方との交流を楽しみ、明日の研究への良い刺激をいただきました。

昨年のMIRU2023に参加した際のレポートは以下の記事をご覧ください。

企業展示

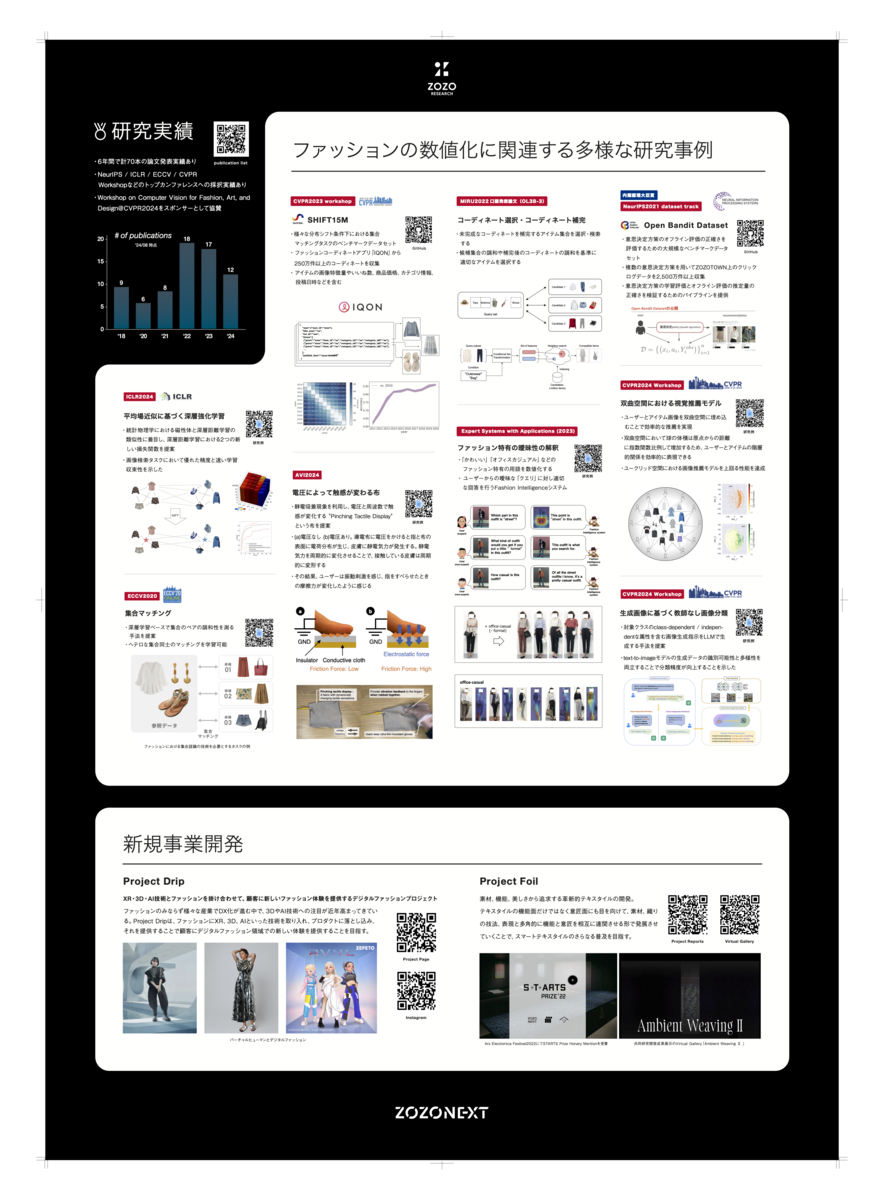

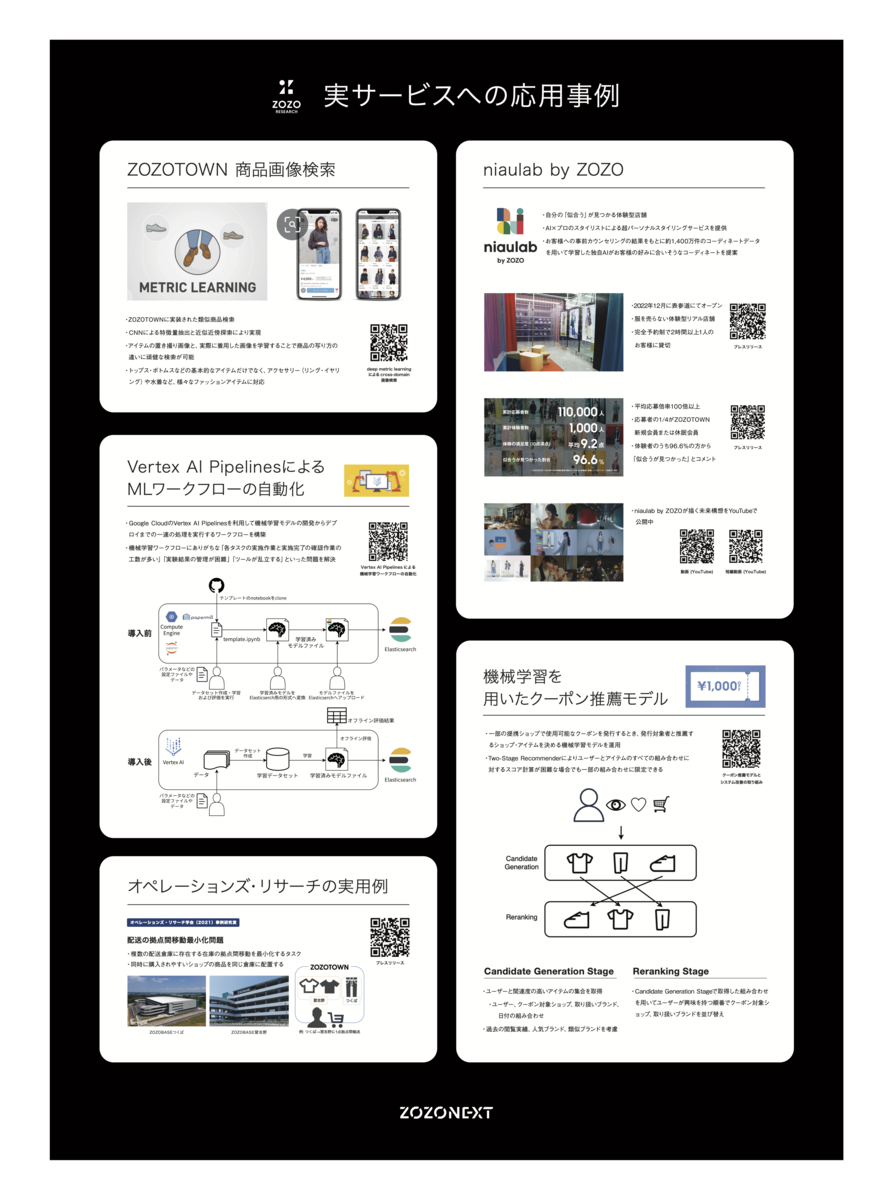

企業展示ブースでは、ZOZO NEXTの取り組みをポスター形式でご紹介しました。ZOZOの多角的なファッションサービスと多様なデータ資産に加え、機械学習や最適化問題の実サービスへの応用事例、そして、ZOZO Researchが近年発表した論文についてご説明しました。多くの方々からご関心をお寄せいただき、お話をさせていただけたことを大変嬉しく感じています。ブースにお越しいただいた皆さま、誠にありがとうございました。展示していたポスターはこちらです。

また、ブースでご案内したZOZO NEXTの求人の最新情報はこちらからご覧になれます。

全体の動向

昨年のMIRUでは、Stable Diffusionをはじめとする生成モデルや基盤モデルを活用した研究が多く見られました。今年は、これらの手法がさらに浸透し、研究のトレンドは「当たり前に使う」段階へとシフトしています。これに伴い、アルゴリズムの詳細な検討や、モデルが持つ事前知識を効果的に活用する方法に焦点が当てられるようになったと感じました。また、ファインチューニングや転移学習を行う際に生じるドメインギャップを埋めるためのドメイン適応の研究も目立ちました。加えて、Neural Radiance Fieldやそれを用いたComputational Photographyに関する研究も盛んに発表されていました。

チュートリアルでは「自動運転のためのビジョン技術」「ビジョン研究のための評価方法」「様々なセンサやモダリティを用いたシーン状態推定」という3つの講演が行われました。

まず「自動運転のためのビジョン技術」講演では、自動運転におけるセンサーやカメラの基本的な役割から最新の深層学習モデルまで、幅広い内容が取り上げられました。単一の鳥瞰図の特徴量を元に、主タスクである経路計画に加え、動作予測などの補助タスクを同時に学習させることで、主タスクの性能を向上させるPARA-Drive手法が非常に興味深いものでした。

次に、「ビジョン研究のための評価方法」では、機械学習の評価手法に関する議論が行われました。この講演では、評価指標が本当に評価したい対象を正確に捉えているのか、また評価指標そのものの性能やデータ選択のノイズの影響、さらに評価データに潜む問題点などが指摘されました。評価手法を評価するための基準を確立するには、多くの小さな問題を考慮する必要があり、その難しさを再認識しました。

最後に、「様々なセンサやモダリティを用いたシーン状態推定」はRGB画像以外の様々な認識手法に関する講演でした。イベントカメラやTime of Flightカメラ、アクティブ音響センシングなどが取り上げられ、これらの技術が従来のRGB画像ベースの手法と異なる環境で有効ということが紹介されました。特に、悪照明環境や遮蔽のある環境での性能向上に寄与するこれらの技術の可能性には驚かされました。RGB画像と比較すると研究例がまだ少ない分野ではありますが、RGB画像以外の認識方法に触れることで、認識技術の世界がさらに広がったと感じました。

招待講演・インタラクティブセッション

招待講演ではZOZOの機械学習エンジニアの住安がCVPR2024に採択された論文について発表しました。こちらの研究についてはCVPR参加レポートで紹介しているので、ぜひご覧ください。加えて、インタラクティブセッションでは、ZOZO Researchから2件、ZOZOから1件の研究をポスター形式で発表しました。各研究の要約は以下の通りです。

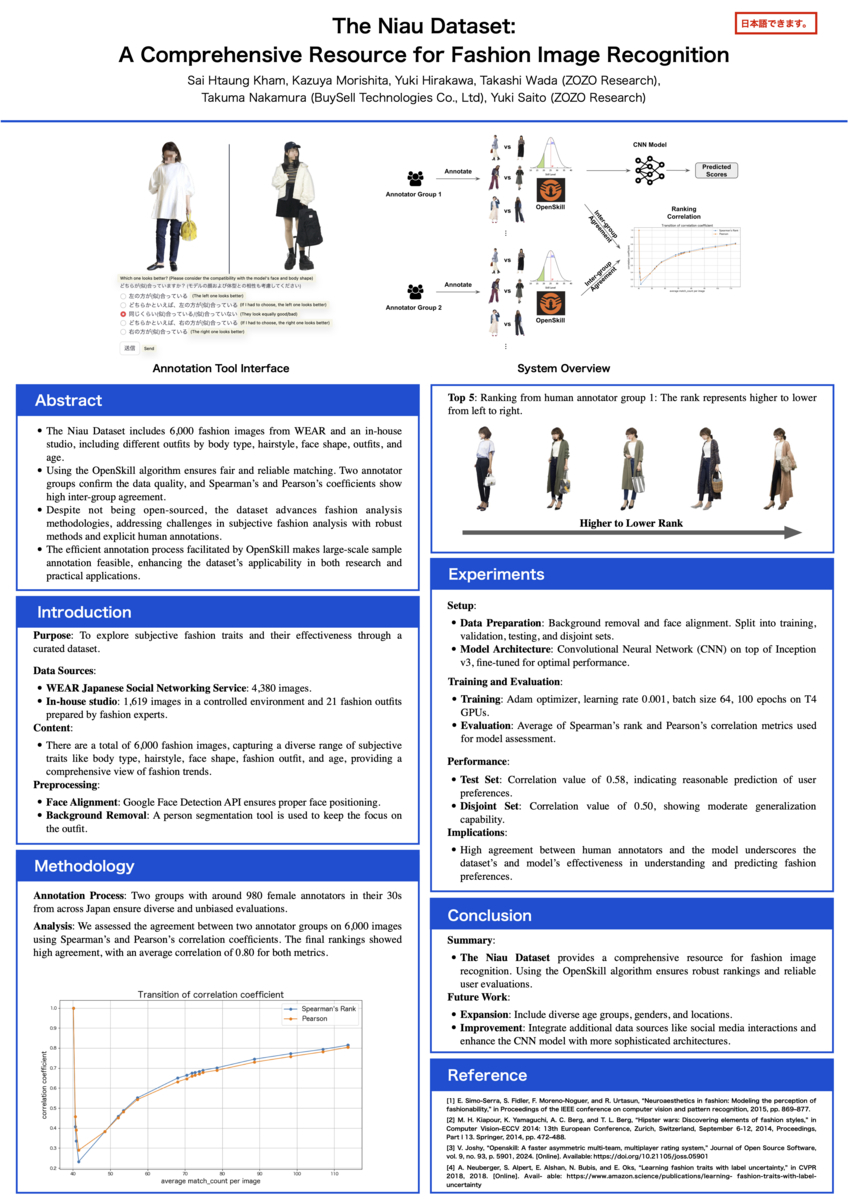

[IS2-35] The Niau Dataset: A Comprehensive Resource for Fashion Image Recognition

Sai Htaung Kham, 森下和哉

, 和田崇史

, 中村拓磨

, 平川優伎

, 斎藤侑輝

(

ZOZO Research,

BuySell Technologies Co., Ltd)

ファッションにおいて、似合うかどうかの数値化は個人のスタイルを理解し、適切な提案をするために重要です。本研究では、ZOZOが運営するファッションSNSであるWEARに投稿された画像とスタジオで撮影した6,000枚のファッション画像からなるNiauデータセットを構築しました。各ファッション画像には、体型、ヘアスタイル、顔の形、着用アイテム、年齢といったラベルに加え、Niauスコアが付与されています。このNiauスコアは、人間のアノテーターに画像のペアを提示し、「どちらがより似合っているか」という質問の回答に基づいて算出された数値です。特に、OpenSkillアルゴリズムを使用することで、得られた回答からスコアを計算し、次の対戦ペアを生成しました。データ品質を確保するために、989名と981名の2つのアノテーターグループが画像を評価し、各グループから得られたNiauスコアの相関をスピアマン順位相関係数およびピアソン相関係数によって確認しました。

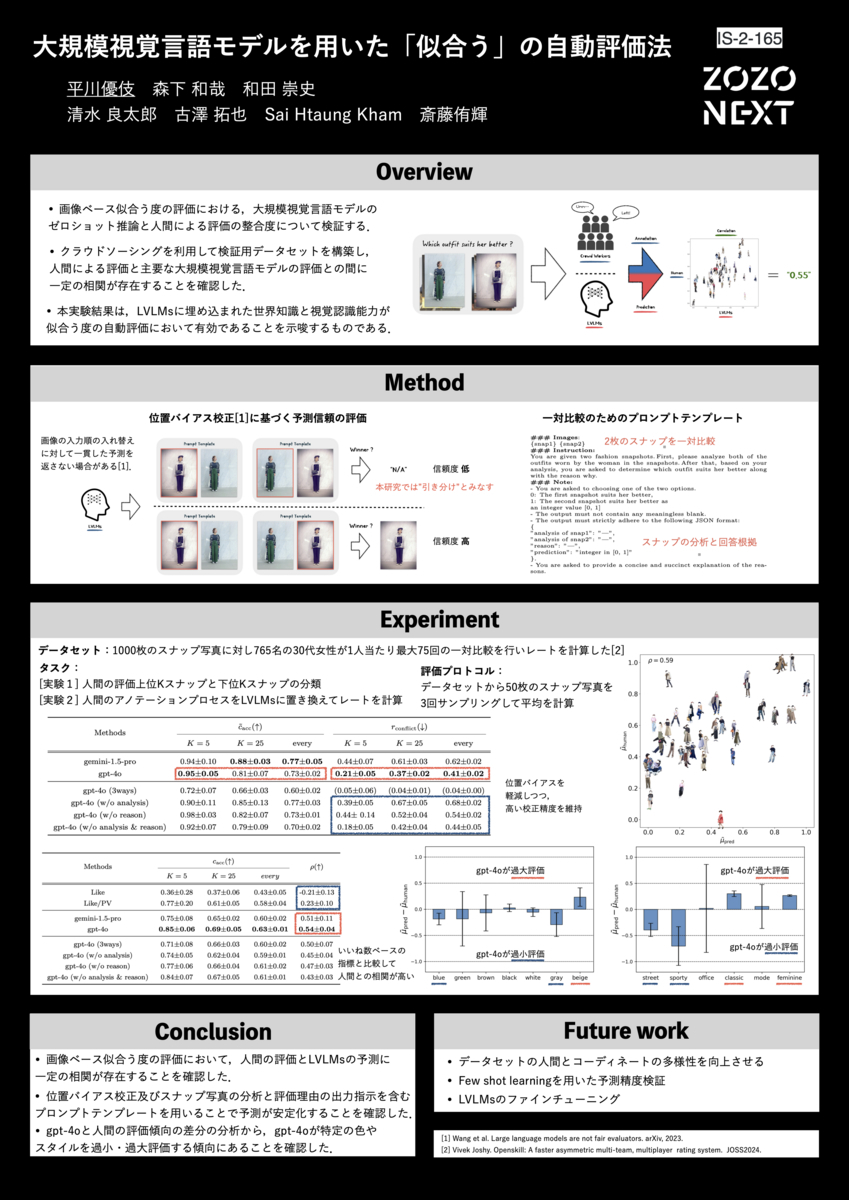

[IS2-126] 大規模視覚言語モデルを用いた「似合う」の自動評価法

平川優伎, 森下和哉, 和田崇史, 清水良太郎, 古澤拓也, Sai Htaung Kham, 斎藤侑輝 (ZOZO Research)

上記のNiauスコアの算出には多大なアノテーション費用がかかるという課題があります。本研究では似合う度の評価における大規模視覚言語モデル (Large-scale Vision Language Models, LVLMs) のゼロショット推論と人間による評価の整合度を検証しました。クラウドソーシングを利用して検証用データセットを構築し、人間による評価と主要なLVLMsの評価との間に一定の相関が存在することを確認しました。この結果は、LVLMsに埋め込まれた世界知識と視覚的な認識能力の画像を元にした似合う度の自動評価における有効性を示唆しています。

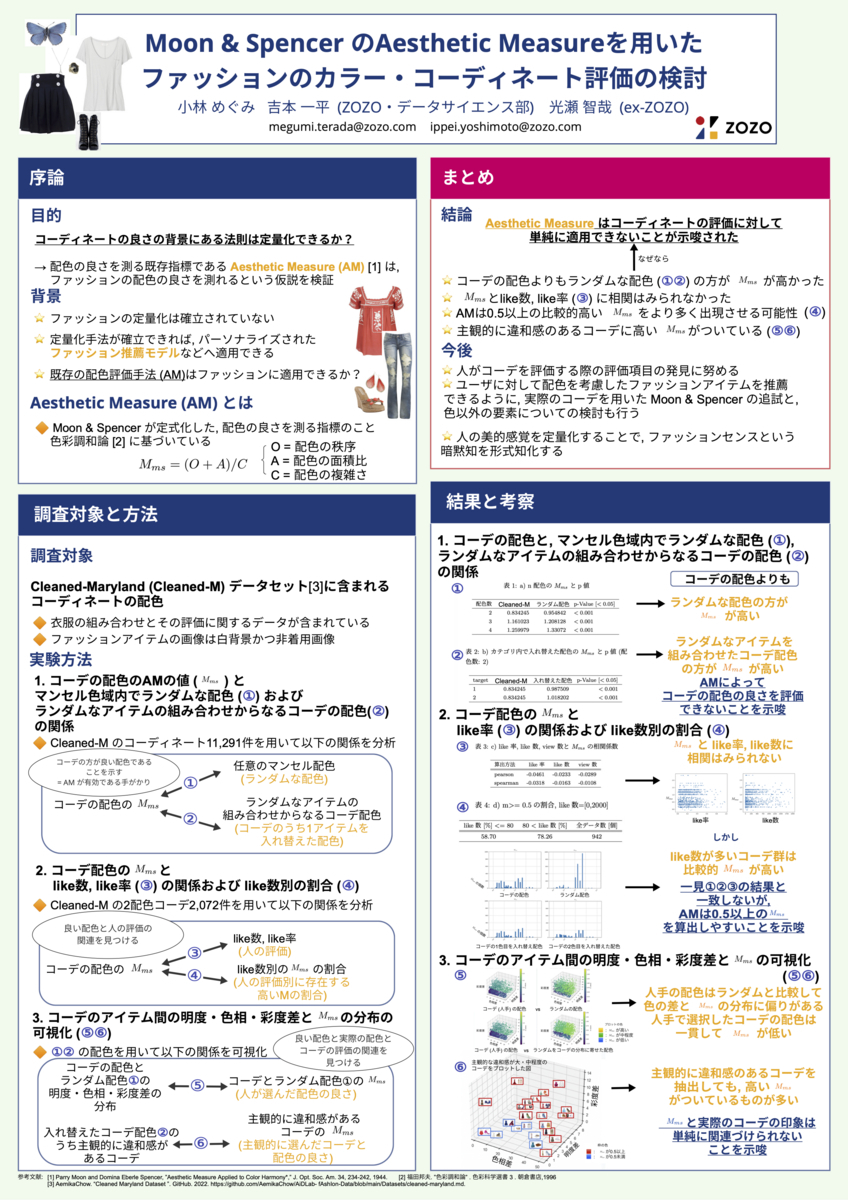

[IS-2-097] Moon & SpencerのAesthetic Measureを用いたファッションのカラー・コーディネート評価の検討

小林めぐみ, 吉本一平

, 光瀬智哉

(

ZOZO,

ex-ZOZO)

ファッションにおけるカラー・コーディネートは、視覚的な美しさや調和を重視する重要な要素の1つです。しかし、コーディネートの定量的な評価手法は未だ確立されておらず、主観的な判断に依存しているのが現状です。この研究では、配色の美的評価において広く利用されるMoon & Spencerの色彩調和指標 (Aesthetic Measure, AM) をカラー・コーディネートに適用できるかを検証しました。まず、ランダムな配色と比較してコーディネートされた配色の方が高いAMの値 (M) を持つという仮説を立て、両者の平均値を比較しました。コーディネートのlike数とMとの関連性を調査し、これを可視化することで、AMがファッションのカラー・コーディネート評価に単純には適用できない可能性があることを示しました。

気になった研究発表

今回の学会では多くの興味深い研究発表がありました。特に私たちが興味を持った研究についていくつか紹介します。

[IS1-119] Neural Lookup TableとPrompt Guidance Lossを用いた解釈可能な画像補正

小林哲 (東工大)

画像補正技術は、InstagramやPhotoshopなど様々なプラットフォームにおいて、写真の印象を操作するために利用されている技術です。旧来のフィルタ技術では、ピクセル間の変換処理をLookup Table (LUT) として保持しておき、入力された画像の各ピクセル値をLUTに従って変換する処理により実現されています。近年では、複数のLUTの加重平均をとることにより、複雑なフィルタ処理を学習ベースで獲得する研究が行われていますが、フィルタ名との対応を人間が解釈可能な形式で取ることができないという課題がありました。この研究では、学習可能かつ解釈可能な画像補正フィルタを実現するために、補正内容を表すテキストと補正後の画像に対して、CLIP-IQA(画像の品質評価に特化したCLIP)を用いて類似度を計算します。特に、負例のテキストと比較して類似度が大きくなるようにフィルタを学習する手法が提案されていました。また、従来手法ではLUTの加重平均ベースのモデルであったのに対し、こちらの研究では比較的シンプルなMLPが導入されており、ベンチマークにおいても良好な結果が得られたそうです。テキストベースで画像の変換処理を行う技術は近年のトレンドであり、生成画像の不自然な点をテキストベースで編集するアプローチなどは応用の幅も広く、弊社としても今後の重要な研究課題になりそうです。

[OS-1D-07] NeuraLeaf: Neural Parametric Leaf Models with Shape and Deformation Disentanglement

Yang Yang, Hiroaki Santo, Yasuyuki Matsushita, Fumio Okura (Osaka Univ.)

こちらは、葉の3Dモデルの再構築・形状生成についての研究です。人間や動物に関する3Dモデリングと再構築の研究は活発になされていますが、植物、特に葉のモデリングにおいては、多様な形状と柔軟な変形を正確に表現することに課題があります。例えば、人間や動物のモデルで用いられるような骨格推定や明確なパーツのセグメンテーションは、葉のモデルに直接適用できません。この研究では、事前学習済みの画像特徴抽出器を用いて葉を擬似的なパーツに分割しています。葉の3次元構造を、2次元の基本形状と3次元の変形に分離し、潜在コードで表現することで、葉の再構成と生成が可能な新しいパラメトリックモデルであるNeuraLeafを提案しています。また、数千枚の葉をスキャンして新しい3次元データセットDeformLeafも作成されていました。対象である葉の特性や特徴について実物をよく観察したうえで、うまく課題を切り分けていると感じました。

[OS-1E-04] スパイキングニューラルネットワークによる画像生成拡散モデル

渡邊諒 (東大), 椋田悠介

, 原田達也

(

東大,

理研)

スパイキングニューラルネットワーク (SNN) は、人間の脳内における信号伝達の仕組みを模倣したニューラルネットワークです。SNNは生物学的に妥当でありながらも計算効率が良いことで、エッジコンピューティングへの実装にも適しています。この研究は、近年話題の拡散モデルによる画像生成ネットワークを、SNNのみを用いて実現することを目的としています。通常の拡散モデルではニューラルネットワークによりガウス分布のパラメータを推定しますが、SNNのニューロンの出力はスパイク列(バイナリ)であるため、ガウス分布のパラメータ推定が困難という課題があります。また、SNNを拡散モデルに適用する場合、確率分布のパラメータを計算するためにSNNの出力をデコードし、再サンプリングする必要がありますが、単純なSNNではこれを解決できません。この研究では、通常の拡散モデルの拡張として、Fully Spiking Denoising Diffusion Implicit Modelを提案しています。さらに、拡散モデルにおける生成過程の各ステップをSNNの計算に置き換えるため、シナプス電流学習も提案し、先述の問題を解決しています。データセットを用いて生成性能を比較した結果、提案手法は既存のSNN画像生成モデルよりも良い性能を示しました。加えて、提案モデルと同じ構造を持つ通常のニューラルネットワークと比べて、計算効率も大幅に向上しているとのことです。一方で、生成性能に関しては通常のニューラルネットワークに及ばず、今後、U-Net部分の性能を向上させるといった改善の余地があるようです。近い将来、モバイル端末などでも拡散モデルを用いた画像生成が活用されていく未来が想像できますし、そんな社会に向けて、本研究は非常に意義のあるものになると思いました。

[IS3-39] 集合データを対象とした識別と生成のマルチタスク学習と信頼度較正への応用

佐藤文興, 早志英朗, 長原一 (阪大)

半教師あり学習は多数のラベルなしデータと少数のラベルつきデータを有効に用い、ラベルつきデータのみを用いた場合より高性能な予測器の構築を目指すタスクです。この研究では集合データの半教師あり学習に際して、教師なしの確率的生成モデルと教師ありの分類器の2つのネットワークを用意します。それらのネットワークでエンコーダ部を共有させることで、ラベルなしのものを含めたデータ分布の再現とラベルつきデータの識別を同時にこなすマルチタスク学習として半教師あり問題を扱うことができます。生成モデルのみに注目すれば教師なし学習なので、ラベルなしデータも有効に活用できると言えます。加えて、このようなアプローチは識別器が出力する信頼度の較正にも有用であることが知られているようです。ところで集合データを扱うネットワークには、入力集合内の要素の並べ替えに対する出力値の不変性 (permutation invariance) など特別な性質が要求されます。これらを満たすSetVAEとよばれる確率的生成モデルを組み込むことで、多くのデータセットに対してラベルなしデータを使用しない場合よりも識別精度が向上し、識別器の出力確率の較正効果も確認できたそうです。集合データの機械学習はZOZO Researchにおいても積極的に取り組んでいるテーマのひとつであり、集合データ特有の難しさがあるのかどうかなど、より精緻な議論が発展していくことを期待したいです。

[IS3-56] 協調フィルタリングにおける潜在因子モデルの埋め込み表現のICAを用いた線形構造の分析

岡村洋希, 前田圭介, 藤後廉, 小川貴弘, 長谷山美紀 (北大)

協調フィルタリングは「類似した消費行動を行う消費者は類似した嗜好をもつ」という信念にもとづいて、各消費者にパーソナライズされた推薦をする手法です。このとき潜在因子モデルを用いると、消費者やアイテムの埋め込み表現を得ることができます。得られた埋め込み表現の解釈は実用上重要な課題ですが、埋め込み表現は一般に高次元であるため、3次元空間の住人である我々にとって容易ではありません。近年、自然言語処理分野において、単語の埋め込み表現を独立成分分析 (ICA) によって次元削減することにより、解釈可能性に優れた軸を得ることができるという報告がなされました。この研究では同様のアプローチを潜在因子モデルによって得られたアイテムの埋め込み表現に適用し、推薦システムの文脈にも有効であることを示しました。具体的には、MovieLensと呼ばれる複数のユーザによる映画の評価データに適用したところ、ICAによって得られた軸の一部が映画のジャンルに対応することが確認されました。ICAは線形変換であるため、一度有効な軸が得られれば新しく追加されたアイテムの埋め込み表現にも適用可能であるなど、扱いやすさの点で優れています。近年は非線形の次元削減が頻繁に用いられますが、「本当に線形の手法ではダメなのか」ということは手法選択の上で常に自問するべきであると改めて感じました。

まとめ

本記事では、MIRU2024の参加レポートをお伝えしました。MIRU2024に参加し、多くの新たな知見を得ることができました。今年も現地で研究の最前線に触れ、最新の技術動向を直接感じることができたのは大変貴重な経験でした。ここで得た知見を今後の研究活動に積極的に取り入れ、さらなる成果を目指していきたいです。

最後に

ZOZO NEXTでは次々に登場する新しい技術を使いこなし、プロダクトの品質を改善できるエンジニアや研究開発を行うリサーチャーを募集しています。ご興味のある方は、以下のリンクからぜひご応募ください。

おまけ

学会期間中は熊本名物である馬刺しにすっかり魅了され、毎日舌鼓を打ちながら味わっていました。