こんにちは、データチームの後藤です。 VASILYデータチームは2017年8月7日〜10日にかけて、広島で行われた第20回画像の認識・理解シンポジウム(以下、MIRU2017)に参加しました。本記事では、発表の様子や参加した感想をお伝えしたいと思います。

MIRU2017

MIRUはMeeting on Image Recognition and Understandingの略で、国内最大規模の画像の認識と理解技術に関する会議です。事前に選定された口頭発表と国際会議の採択論文から選ばれた招待講演を中心に、ポスター発表、デモ発表、特別講演で構成されます。

今年の投稿件数は、以下のような内訳でした。

- 口頭発表:23件

- 一般論文:206件

- デモ論文:13件

- 招待講演:12件

- 企業展示:15件

VASILYのデータチームは「トリプレット損失関数の重み付けによる学習の効率化」というタイトルで一般論文の枠で投稿し、4日目の8月10日にポスター発表を行いました。

発表

ポスターセッションでは始終、多くの人に話を聞いていただき、VASILYの取り組みを伝えることができました。今回の我々の研究は数式と文字による説明が多く、ひと目でわかりやすい研究ではなかったかもしれませんが、皆様の積極的に理解しようとする姿勢がとてもうれしくやりがいがありました。研究者の方々からその場で改善に関する貴重なアドバイスをいただいたり、ファッションと機械学習について改めて意見交換をする話になったりと、実りのある時間になったと思います。技術的な内容については別の記事で扱いたいと思います。

MIRU2017 発表ポスター

感想

国内外の素晴らしい研究成果を学ぶことで、研究のアイデアを多く得られたことがなによりの収穫でした。弊社の機械学習を使ったプロダクトでは物体検出や生成モデル、属性予測モデルなどでCNNを活用していますが、その高度化に使えそうな研究が多くありました。招待講演は、すでに有名な国際会議で発表されている研究を紹介する企画でしたが、勉強不足で把握していなかった研究やアイディアが多くあったため、とても有難かったです。弊社では早速、今回の学会参加で得られた知見を取り入れる実験を開始しています。

また、ファッションの画像を使った研究に取り組んでいる研究者や学生と議論や意見交換をできたことも良かったです。ファッションの画像の研究という特定の分野に携わっている人たちが集まる機会はなかなか無いため、論文として発表されない限り、どこでどんなことに取り組まれているのかを知ることはできません。MIRUに参加することで、様々な研究機関の取り組みと取り組んでいる人たちを把握できたことは貴重な機会でした。

気になった研究

個人的に興味をもった研究を簡単にご紹介します。

[PS1-28] キャッシュ型k-d木:クエリの偏りを用いた近似最近傍探索法

香川 椋平, 和田 俊和(和歌山大)

近似最近傍探索において、登録データの統計的分布を利用する手法は多くある一方で、クエリの統計的偏りは検討されてきませんでした。この研究では、k-d木による探索のうち、木探索とpriority searchの結果が異なるクエリをキャッシュすることで時間の掛かるpriority searchを省略するという方法を提案し、k-d木による探索の高精度化・高速化に成功しました。弊社でも大量の画像を検索するタスクが多いため、クエリの偏りを利用してキャッシュしておくというアイデアは利用できそうです。

[DS-3] キーポイントの幾何学的一貫性を考慮した実時間画像検索システム

大倉 有人, 和田 俊和(和歌山大)

画像検索において、クエリにカメラで撮影した画像を用いる場合、検索したい物体以外のものが含まれてしまうことが多いです。この研究では、データベース上の画像とクエリ画像の、SURFで検出されたキーポイントの各組から相似変換を推定し、推定された各相似変換を集計します。最も投票の多かった相似変換に従うキーポイントの組を採用することで、クエリ画像上の検索対象と無関係な背景の効果を実時間のうちに除去することが可能になりました。

[OS4-1] Dynamic Fashion Cultures

Kaori Abe, Teppei Suzuki, Shunya Ueta(AIST), Akio Nakamura(Tokyo Denki Univ.), Yutaka Satoh, Hirokatsu Kataoka(AIST)

この研究では、世界中のファッショントレンドを時系列で分析・可視化することを目的とし、位置と時間の情報を持った人物画像の巨大データベースを作成しました。Yahoo! Creative Commons 100M Databaseから人物を切り出し、タイムスタンプとジオタグを付与しています。画像特徴量をクラスタリングして、各クラスタの数の時系列変化を見ることで、特徴的なファッショントレンドを抽出しています。

この研究では1年ごとのトレンドを見ていますが、ファッション業界からは1週間スケールでのトレンドを把握したいという要望があるようです。これは非常に難しい課題ですが、応用第一のファッションテックにおいて、とても重要な課題になるでしょう。

[PS2-27] ディープラーニングによるファッションコーディネートの分類

高木 萌子, シモセラ エドガー, 飯塚 里志, 石川 博(早大)

ファッションアイテムの推薦はユーザーのスタイルを把握していなければ難しいタスクです。この研究では、13000枚以上のトータルコーディネートの画像を収集し14種類のファッションカテゴリに分類したデータセットを作成し、CNNを用いたファッションカテゴリ判別器を学習しました。ファッションの専門家と素人の判別精度の中間程度の精度を達成しています。ポスター発表ではCNNが判別の際に注目している位置を可視化しており、その判断基準には納得感のあるものが多かったです。弊社の推薦システムにおいても、ユーザーの好むファッションスタイルを理解することが重要なので、この研究を発展させていきたいです。

[PS1-59] 衣服情報の活用による姿勢推定の精度向上に関する研究

金子 直史, 鷲見 和彦(青学大)

この研究では、人の体型を画像から測る目的から、精度の高い姿勢推定のネットワークを作成しています。通常の姿勢推定用のネットワークの出力に、衣服のセグメンテーションを行った結果を加えることでより精度の高い姿勢推定を行うネットワークを実現しました。この研究では2つのネットワークを単純に合わせたものが提案されていましたが、姿勢推定の誤差を修正するネットワークも有効なのではないかという議論をしました。

[OS5-6] 2D-QRNNを導入したDCNNによるセマンティックセグメンテーションの高精度化と高速化

古川 弘憲, 山下 隆義, 山内 悠嗣, 藤吉 弘亘(中部大), 石井 育規, 羽川 令子(パナソニック)

局所的な情報を活用するCNNに、文脈情報を考慮できるRNNを組み合わせることにより、セマンティックセグメンテーションの精度を上げられることが知られています。しかし、通常のRNNでは並列演算が出来ず、推論に掛かる時間のボトルネックとなってしまいます。この研究では、二次元に拡張したQuasi-Recurrent Neural Networksを用いることで、DAG-RNNと同程度の精度を保ちながら推論にかかる時間を29%まで削減できました。

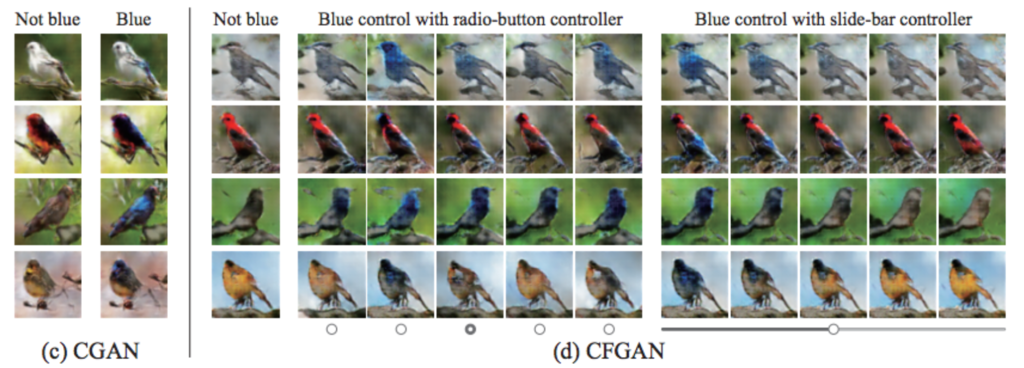

[IT-8]【招待講演】Generative Attribute Controller With Conditional Filtered Generative Adversarial Networks (CVPR2017)

Takuhiro Kaneko, Kaoru Hiramatsu, Kunio Kashino

この研究では、Conditional GANを拡張し、ノイズ変数を属性情報でフィルタリングするアーキテクチャを加えたCFGANを提案しています。画像の属性情報を操作して、画像を変換するタスクにおいて、提案手法は属性の表現力と操作性を向上させることに成功しています。

フィルタリングの方法を変えることにより、ラジオボタンやスライドバーによる変換など、従来よりも操作性の高い方法を実現できています。ファッションの画像検索においても、このような属性変換による画像検索は実用性が高いと考えます。

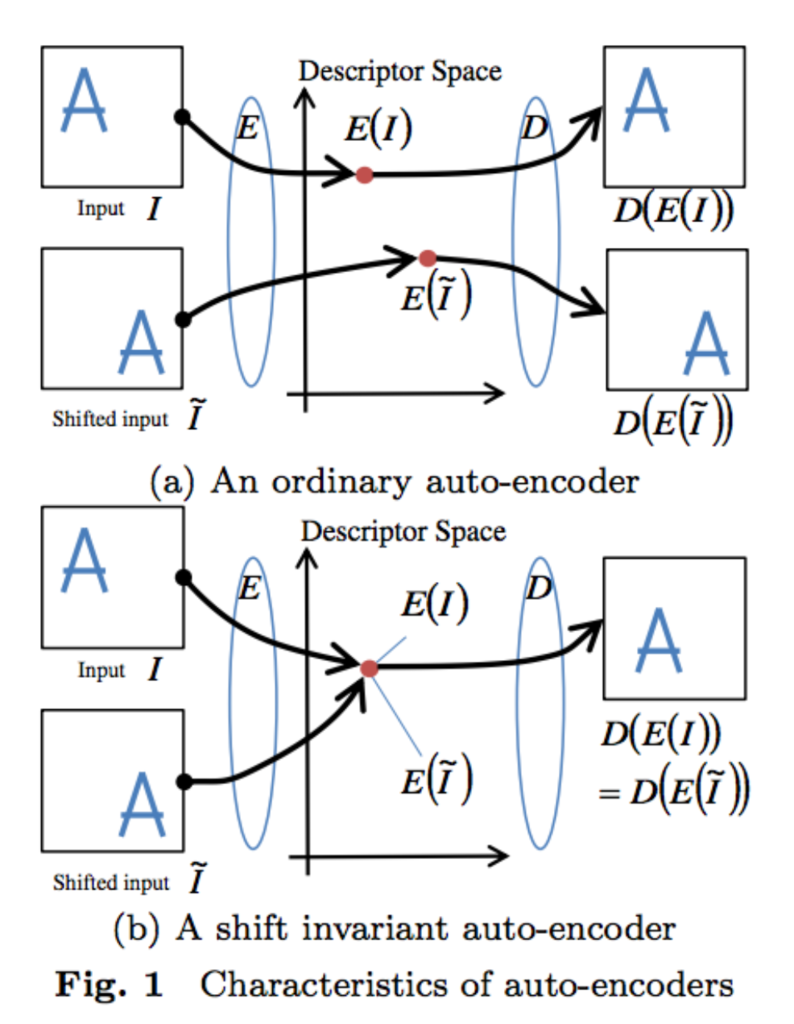

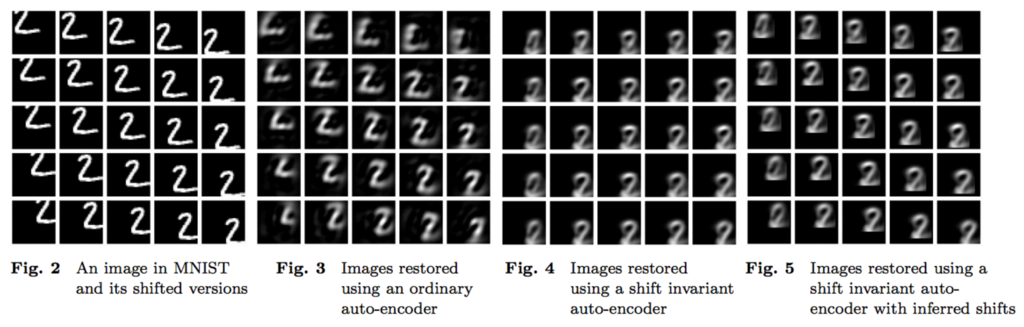

[OS5-5] Segmentation based on Transform Invariant Auto-encoder

Tadashi Matsuo, Nobutaka Shimada(Ritsumeikan Univ.)

この研究では、上図のように平行移動やバックグラウンドに不変なオートエンコーダーを提案しています。変換無し画像の復元画像と、平行移動などの変換を施した画像の復元画像が近くなるように設計したTransform variance termと、変換を施した画像と復元画像が近くなるよう設計した Restoration error termをコスト関数に用いて学習します。

設計の意図の通り、入力画像の位置が異なっても(上のFig.2)、出力はほとんど同じものとなっています(上のFig.4)。

[PS2-20] 適応的ランク誤差に基づくTriplet 局所特徴表現学習

田良島 周平, 黒住 隆行, 杵渕 哲也(NTT)

通常のトリプレット損失関数は、アンカー(a)と負例(n)の距離がアンカーと正例(p)の距離よりも固定のマージン以上に小さい場合に誤差をとる損失関数です。しかし、上図の左のように各距離がマージンよりも十分に大きい場合、相対的にマージンの効果が小さくなり、誤差が発生しない状況が増えてしまいます。この研究では、固定していたマージンをアンカーと正例の距離に対して適応的に変化させることで、各距離がマージンよりも十分に大きい場合の弁別性の向上を狙いました。提案手法は、パッチペアの分類推定と射影変換推定のタスクにおいて、Hard miningを行う手法以外の多くの場合で、既存手法を上回る性能を発揮しています。

おまけ

本記事の趣旨とはずれますが、学会の合間に広島を満喫しましたので写真で紹介します。

厳島神社

干潮時の厳島神社の鳥居。カニを捕まえるのに夢中になってしまいました。

鹿(宮島)

宮島は鹿が出迎えてくれます。我々と一緒に歩いてくれる優しい鹿もいました。

お好み焼き(ロペズ)

横川のロペズでお好み焼きを食べました。とても有名なお店だそうで、一時間近く並びました。ハラペーニョをトッピングした風変わりなお好み焼きを提供してくれます。

あなご竹輪(宮島)

あなご感、特になし…!!

最後に

VASILYでは、最新の研究にアンテナを張りながら、同時にユーザーの課題解決を積極的に行うメンバーを募集しています。本記事のように、業務の一環として学会に参加することを認められる環境です。 興味のある方はこちらからご応募ください。